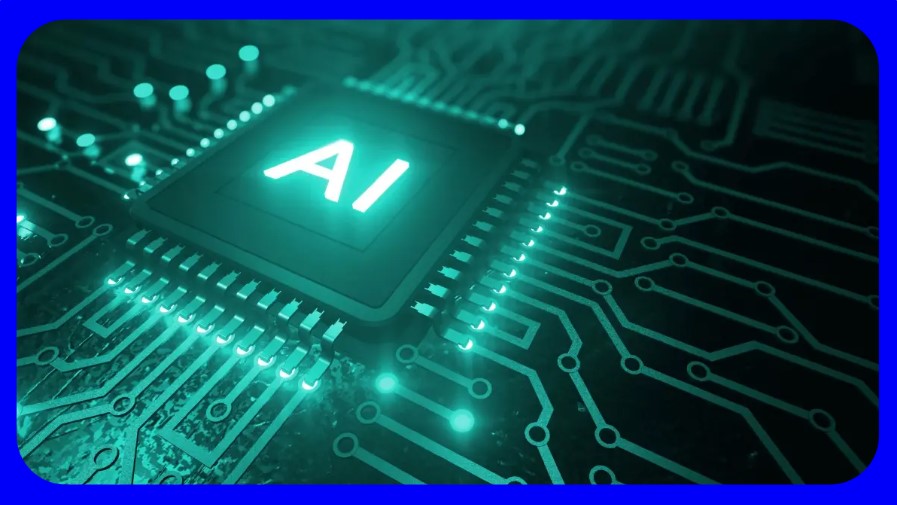

การควบคุม AI ก้าวหน้า: บริษัทชั้นนำให้คำมั่นใหม่ที่โซล

บริษัทปัญญาประดิษฐ์ชั้นนำได้ให้คำมั่นใหม่ในการประชุม

AI

Safety Summit ที่กรุงโซล ในการพัฒนา AI อย่างปลอดภัย

โดยบริษัท 14 แห่งได้ลงนามอย่าง Google, Meta,

OpenAI, และบริษัทเกาหลี 6 แห่ง

เพื่อใช้วิธีการต่าง ๆ เช่น การฝังลายน้ำเพื่อช่วยระบุเนื้อหาที่สร้างโดย AI

รวมถึงการสร้างงานและการช่วยเหลือกลุ่มที่เปราะบางทางสังคม

ขณะที่ผู้นำโลกตกลงที่จะสร้างเครือข่ายสถาบันความปลอดภัยที่ได้รับการสนับสนุนจากสาธารณะเพื่อพัฒนาการวิจัยและทดสอบเทคโนโลยีนี้

เกาหลีใต้

22 พฤษภาคม 2567 - รอยเตอร์ระบุ

รัฐมนตรีว่าการกระทรวงวิทยาศาสตร์และเทคโนโลยีสารสนเทศของเกาหลีใต้กล่าวว่า

โลกต้องร่วมมือกันเพื่อให้การพัฒนา AI ประสบความสำเร็จ

ในขณะที่การประชุมสุดยอดระดับโลกเกี่ยวกับเทคโนโลยีที่พัฒนาอย่างรวดเร็วซึ่งจัดโดเกาหลีใต้ได้สิ้นสุดลงแล้ว

การประชุม

AI

ในกรุงโซล ซึ่งร่วมเป็นเจ้าภาพโดยอังกฤษ

ได้หารือเกี่ยวกับความกังวลต่าง ๆ เช่น ความมั่นคงในการทำงาน ลิขสิทธิ์

และความไม่เท่าเทียมได้เกิดขึ้น (22 พ.ค.)

หลังจากที่บริษัทเทคโนโลยี 16

แห่งได้ลงนามในข้อตกลงโดยสมัครใจในการพัฒนา AI อย่างปลอดภัยเมื่อวันก่อน

ในวันที่จัดประชุมนี้ได้มีการลงนามข้อตกลงที่แยกต่างหากโดยบริษัท

14 แห่ง รวมถึง Google, Meta, OpenAI, และบริษัทเกาหลี

6 แห่ง เพื่อใช้วิธีการต่าง ๆ เช่น

การฝังลายน้ำเพื่อช่วยระบุเนื้อหาที่สร้างโดย AI รวมถึงการสร้างงานและการช่วยเหลือกลุ่มที่เปราะบางทางสังคม

การประชุมสุดยอด

AI

ระดับโลกครั้งแรกจัดขึ้นในอังกฤษเมื่อเดือนพฤศจิกายนที่ผ่านมา

และการประชุมครั้งต่อไปมีกำหนดจะจัดขึ้นในฝรั่งเศส ซึ่งน่าจะเป็นในปี 2025

รัฐมนตรีและเจ้าหน้าที่จากหลายประเทศได้หารือกันเมื่อวันพุธเกี่ยวกับความร่วมมือระหว่างสถาบันความปลอดภัย

AI

ที่ได้รับการสนับสนุนจากรัฐเพื่อช่วยควบคุมเทคโนโลยีนี้

ผู้เชี่ยวชาญด้าน

AI

ยินดีกับขั้นตอนที่ดำเนินการจนถึงขณะนี้ในการเริ่มควบคุมเทคโนโลยี

แม้ว่าบางคนจะกล่าวว่าต้องบังคับใช้กฎระเบียบ

"เราจำเป็นต้องก้าวข้ามการสมัครใจ...

ผู้ที่ได้รับผลกระทบควรกำหนดกฎระเบียบผ่านรัฐบาลของประเทศ" Francine

Bennett ผู้อำนวยการสถาบัน Ada Lovelace ที่มุ่งเน้นด้าน

AI กล่าว

บริการ

AI

ควรได้รับการพิสูจน์ว่าตรงตามมาตรฐานความปลอดภัยบังคับก่อนออกสู่ตลาด

ดังนั้นบริษัทต่าง ๆ จึงถือว่าความปลอดภัยเท่ากับผลกำไร

และป้องกันการตอบโต้ต่อสาธารณะที่อาจเกิดขึ้นจากอันตรายที่ไม่คาดคิด กล่าวโดย Max

Tegmark ประธาน Future of Life Institute องค์กรที่เป็นแกนนำเกี่ยวกับความเสี่ยงของระบบ

AI

ที่มา

:

M Report

วันที่

12 มิถุนายน 2567