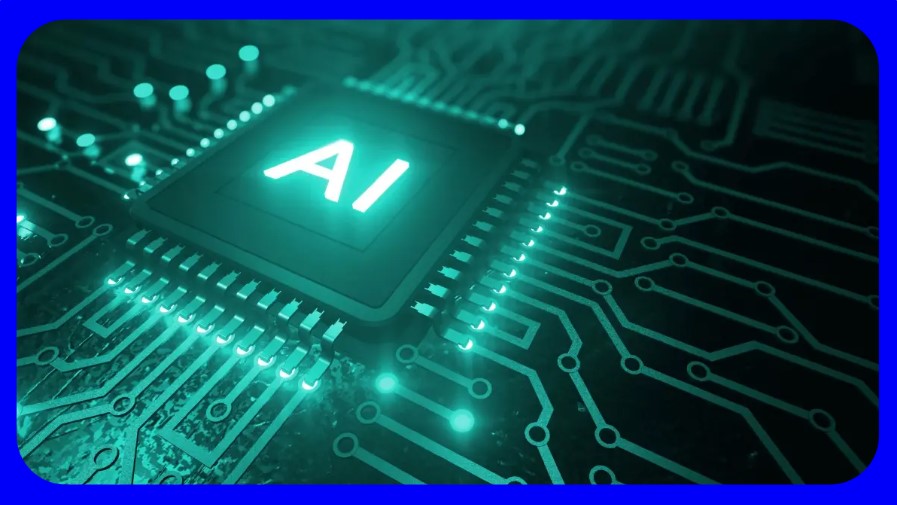

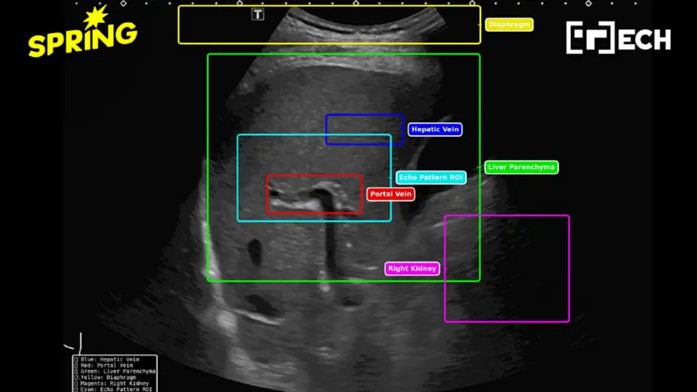

สหรัฐฯ ตั้งผู้บริหารบิ๊กเทค เป็นกรรมการให้คำแนะนำและรับมือการโจมตีด้วย AI

รัฐบาลสหรัฐฯ

มีความพยายามในการจัดการกับผลกระทบจากปัญญาประดิษฐ์ หรือ AI

ที่มีต่อความมั่นคงและความปลอดภัย

โดยการตั้งคณะกรรมการที่ประกอบด้วยผู้นำจากบริษัท AI ชั้นนำ

เพื่อให้คำแนะนำในประเด็นสำคัญๆ

กระทรวงความมั่นคงแห่งมาตุภูมิของสหรัฐฯ

ประกาศว่าคณะกรรมการที่ปรึกษาแนะนำวิธีป้องกันการโจมตีด้วยปัญญาประดิษฐ์ หรือ AI

ที่กำลังจัดตั้งขึ้นใหม่นี้

จะประกอบด้วยผู้นำระดับสูงจากบริษัทเทคโนโลยีและอุตสาหกรรมที่ใหญ่ที่สุดในโลก

ได้แก่

1. ซุนดาร์

พิชาย (Sundar

Pichai) ซีอีโอของ Google

2.

ซัตยา นาเดลลา (Satya

Nadella) ซีอีโอของ Microsoft

3. แซม

อัลท์แมน (Sam Altman) ซีอีโอของ OpenAI

นอกจากนี้ยังมีผู้บริหารจากบริษัทคู่สัญญาด้านกลาโหม

เช่น Northrop

Grumman และสายการบิน Delta Air Lines ร่วมอยู่ในคณะกรรมการชุดนี้ด้วย

โดยคณะกรรมการชุดนี้

จะจัดทำคำแนะนำสำหรับภาคการขนส่ง ผู้ให้บริการท่อส่งและโครงข่ายไฟฟ้า

ผู้ให้บริการอินเทอร์เน็ต ระบบสาธารณูปโภค และอื่นๆ

เพื่อป้องกันและเตรียมความพร้อมรับมือกับการหยุดชะงักที่เกี่ยวข้องกับ

AI

ในบริการที่มีความสำคัญต่อประเทศ

ซึ่งอาจส่งผลกระทบในวงกว้างต่อความมั่นคง เศรษฐกิจ สาธารณสุข

และความปลอดภัยของประชาชน

Alejandro

Mayorkas รัฐมนตรีกระทรวงความมั่นคงแห่งมาตุภูมิ

กล่าวกับผู้สื่อข่าวว่า คณะกรรมการจะช่วยรับประกันการนำเทคโนโลยี AI ไปใช้อย่างปลอดภัย

และวิธีจัดการกับภัยคุกคามที่เกิดจากเทคโนโลยีนี้ต่อบริการที่สำคัญ เช่น พลังงาน

สาธารณูปโภค การขนส่ง การป้องกัน เทคโนโลยีสารสนเทศ อาหารและการเกษตร

และบริการทางการเงิน

“คณะกรรมการจะไม่ได้มุ่งเน้นไปที่ทฤษฎี

แต่เป็นแนวทางการแก้ปัญหาเชิงปฏิบัติสำหรับการนำ AI ไปใช้ในชีวิตประจำวันของประเทศ

การนำนักพัฒนาที่มีความสำคัญของเครื่องมืออันทรงพลังอย่าง AI มาร่วมงานเป็นสิ่งสำคัญและตรงจุดอย่างมาก"

ความเคลื่อนไหวดังกล่าวสะท้อนให้เห็นถึงความร่วมมืออย่างใกล้ชิดของรัฐบาลสหรัฐฯ

กับภาคเอกชน ในขณะที่กำลังเร่งจัดการกับทั้งความเสี่ยงและประโยชน์ของ AI

ในกรณีที่ไม่มีกฎหมายเกี่ยวกับ AI ที่ชัดเจน

นอกจากผู้นำจากบริษัทเทคโนโลยียักษ์ใหญ่แล้ว

คณะกรรมการความปลอดภัยและการรักษาความปลอดภัย AI ยังประกอบด้วยผู้เชี่ยวชาญจากภาคส่วนที่หลากหลาย

ซึ่งจะช่วยให้สามารถพิจารณาประเด็นด้าน AI ได้อย่างรอบด้าน

ทั้งในแง่ของเทคโนโลยี ผลกระทบต่อสังคม กฎหมาย และนโยบายสาธารณะ

1. ผู้ให้บริการเทคโนโลยี

เช่น Amazon

Web Services, IBM และ Cisco

2. ผู้ผลิตชิปอย่าง

AMD

3. นักพัฒนาโมเดล

AI

อย่าง Anthropic

4. กลุ่มสิทธิพลเมือง

เช่น คณะกรรมการทนายความเพื่อสิทธิพลเมืองภายใต้กฎหมาย

5. เจ้าหน้าที่จากรัฐบาลกลาง

รัฐ และท้องถิ่น

6. นักวิชาการชั้นนำด้าน

AI

อย่าง ศาสตราจารย์ Fei-Fei Li จากมหาวิทยาลัยสแตนฟอร์ด

คณะกรรมการความปลอดภัยและการรักษาความปลอดภัย

AI

ที่มีสมาชิก 22

คนจัดตั้งขึ้นตามคำสั่งของประธานาธิบดีโจ ไบเดน ในปี 2023

ซึ่งเรียกร้องให้องค์กรข้ามอุตสาหกรรมจัดทำ

“คำแนะนำสำหรับการปรับปรุงความปลอดภัย การปรับตัว

และการตอบสนองต่อเหตุการณ์ที่เกี่ยวข้องกับโครงสร้างพื้นฐานการใช้งาน AI ในภาวะวิกฤติ”

คำสั่งนี้ยังนำไปสู่การสร้างกฎระเบียบทั่วไปสำหรับหน่วยงานรัฐบาลกลาง

ในการจัดซื้อและใช้งาน AI ในระบบของตนเองได้

ซึ่งปัจจุบันรัฐบาลสหรัฐฯ ได้นำ AI และ machine

learning ไปใช้งานในกว่า 200 วัตถุประสงค์แล้ว

เช่น การติดตามภูเขาไฟ ไฟป่า และการระบุสัตว์ป่า ผ่านภาพถ่ายดาวเทียม

คณะกรรมการชุดนี้มีกำหนดประชุมครั้งแรกในเดือนหน้า

และจะประชุมเป็นประจำทุกไตรมาสในอนาคต เพื่อจัดทำและเสนอแนะนโยบายด้าน AI

ที่สำคัญต่อประเทศ

ที่มา : Springnews

วันที่ 30 เมษายน 2567