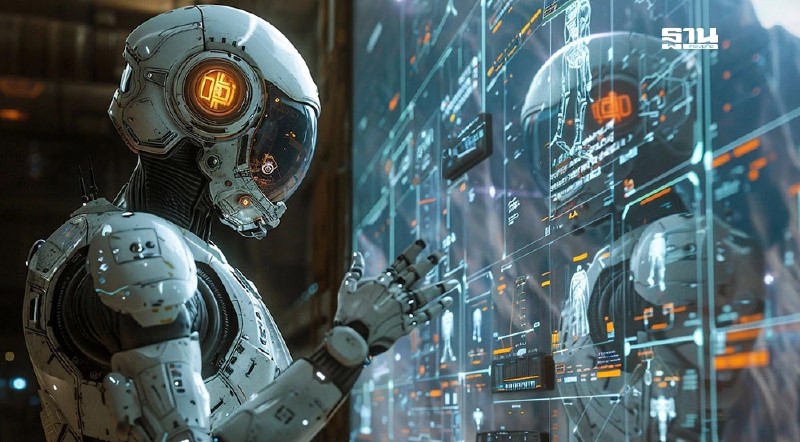

คาดปี 68 Generative AI ส่งผลกระทบวงกว้าง ความสามารถเทียบเท่ามนุษย์

การ์ทเนอร์

เผยการคาดการณ์เชิงกลยุทธ์ที่สำคัญสำหรับปี 2568 และอนาคตข้างหน้า

โดยการ์ทเนอร์ระบุว่า Generative AI (Gen AI) กำลังส่งผลกระทบวงกว้างต่อพื้นที่ที่เคยมีแต่มนุษย์เท่านั้นที่สามารถทำได้

นายแดริล พลัมเมอร์ รองประธานอาวุโส

หัวหน้าฝ่ายวิจัย และ Gartner Fellow กล่าวว่า

"เป็นที่ชัดเจนว่าไม่ว่าเราจะไปไหนก็หลีกเลี่ยงผลกระทบของ AI ไม่ได้ และ AI ก็กำลังพัฒนาไปพร้อม ๆ

กับการใช้งานของมนุษย์ ก่อนที่จะไปถึงจุดที่มนุษย์ไล่ตามไม่ทัน

เราต้องยอมรับก่อนว่า AI ช่วยให้เราพัฒนาได้ขึ้นมากแค่ไหน"

ในปี 2569 องค์กร 20% จะใช้ AI

ปรับโครงสร้างองค์กรให้แบนราบลง

โดยลดตำแหน่งผู้บริหารระดับกลางที่มีอยู่ในปัจจุบันลงมากกว่าครึ่ง

องค์กรที่นำ AI

มาใช้เพื่อลดจำนวนผู้บริหารระดับกลางจะสามารถลดต้นทุนค่าจ้างในระยะสั้นและทำให้องค์กรประหยัดขึ้นในระยะยาว

ซึ่งการนำ AI มาใช้จะช่วยเพิ่มประสิทธิภาพการทำงานและขยายขอบเขตการควบคุม

ด้วยการทำให้เป็นอัตโนมัติ ทั้งการจัดตารางงาน การรายงาน

และการติดตามผลการปฏิบัติงานของพนักงาน

ซึ่งช่วยให้ผู้จัดการมุ่งเน้นไปที่กิจกรรมเชิงกลยุทธ์ที่มีความยืดหยุ่นและมีมูลค่าเพิ่มมากขึ้น

การนำ AI มาใช้จะนำมาซึ่งความท้าทายให้กับองค์กร เช่น

พนักงานส่วนใหญ่กังวลเกี่ยวกับความมั่นคงในงาน

ขณะที่ผู้จัดการก็หนักใจกับจำนวนผู้ใต้บังคับบัญชาที่เพิ่มขึ้น

และพนักงานที่เหลือไม่เต็มใจเปลี่ยนแปลงหรือยอมรับการใช้ AI มาเป็นตัวขับเคลื่อนการมีปฏิสัมพันธ์ร่วมกัน

และอาจส่งผลต่อเส้นทางการเป็นพี่เลี้ยงสอนและการเรียนรู้ล่มสลาย

จนทำให้พนักงานระดับล่างขาดโอกาสในการพัฒนา

ในปี 2571

การจมดิ่งไปในเทคโนโลยีจะส่งผลกระทบต่อประชากรในด้านการเสพติดดิจิทัลและการแยกตัวจากสังคม

ส่งผลให้ 70% ขององค์กรต้องนำนโยบายต่อต้านดิจิทัลมาใช้งาน

การ์ทเนอร์คาดการณ์ว่าในปี 2571

จะมีประชากรประมาณหนึ่งพันล้านคนที่ได้รับผลกระทบจากการเสพติดดิจิทัล

ซึ่งส่งผลทำให้ประสิทธิภาพการทำงานลดลง มีความเครียดเพิ่มขึ้น

และเกิดปัญหาสุขภาพจิตเพิ่มขึ้นอย่างรวดเร็ว เช่น มีความวิตกกังวลและภาวะซึมเศร้า

นอกจากนี้ การจมดิ่งในดิจิทัลจะส่งผลกระทบในแง่ลบต่อทักษะทางสังคม

โดยเฉพาะกลุ่มคนรุ่นใหม่ที่มีแนวโน้มจะได้รับผลกระทบมากกว่า

นายพลัมเมอร์ กล่าวว่า

"ผลกระทบของการแยกตัวจากการจมดิ่งในดิจิทัลจะนำไปสู่แรงงานที่แตกแยก (Disjointed

Workforce) ทำให้องค์กรพบว่าประสิทธิภาพการทำงานของพนักงานและผู้ร่วมงานลดลงอย่างมีนัยสำคัญ

ดังนั้นองค์กรจำเป็นต้องกำหนดช่วงเวลาดีท็อกซ์ดิจิทัลให้เป็นข้อบังคับสำหรับพนักงาน

สั่งห้ามการสื่อสารนอกเวลางาน

และนำเครื่องมือและเทคนิคแบบแอนะล็อกกลับมาใช้เป็นข้อบังคับ อาทิ การประชุมที่ปลอดหน้าจอ

การงดใช้อีเมลในวันศุกร์ หรือการพักรับประทานอาหารกลางวันนอกโต๊ะทำงาน"

ในปี 2572 คณะกรรมการบริษัท 10%

ทั่วโลกจะใช้ AI guidance เพื่อท้าทายการตัดสินใจของผู้บริหารที่มีผลกระทบสำคัญต่อธุรกิจ

ข้อมูลเชิงลึกที่สร้างขึ้นจาก AI

จะมีผลกระทบวงกว้างต่อการตัดสินใจของผู้บริหาร

และทำให้กรรมการบริษัทนำมาใช้ท้าทายการตัดสินใจของผู้บริหาร

นี่จะเป็นการหมดยุคของซีอีโอที่ชอบตัดสินใจตามอำเภอใจโดยไม่มีเหตุผลรองรับ

นายพลัมเมอร์ กล่าวว่า "ในช่วงแรก

ข้อมูลเชิงลึกจาก AI จะดูคล้ายกับรายงานแยกย่อย

หรือ Minority Report ที่ไม่สะท้อนมุมมองของกรรมการส่วนใหญ่

อย่างไรก็ตาม เมื่อข้อมูลเชิงลึกที่ได้จาก AI นี้

พิสูจน์ให้เห็นถึงประสิทธิผล

มันจะได้รับการยอมรับในหมู่ผู้บริหารที่แข่งกันหาข้อมูลสนับสนุนการตัดสินใจเพื่อปรับปรุงผลลัพธ์ทางธุรกิจ”

ในปี 2571 องค์กรขนาดใหญ่ 40% จะนำ AI

มาใช้เพื่อจัดการและวัดอารมณ์รวมถึงพฤติกรรมของพนักงาน

ทั้งหมดก็เพื่อผลกำไร

AI

มีความสามารถวิเคราะห์ความรู้สึกจากการมีปฏิสัมพันธ์และการสื่อสารในที่ทำงาน

สิ่งนี้ให้ข้อมูลย้อนกลับเพื่อให้เข้าใจถึงความรู้สึกโดยรวมที่สอดคล้องกับพฤติกรรมที่กำหนด

ช่วยให้ทีมงานมีแรงจูงใจและมีส่วนร่วมในการทำงาน

"พนักงานอาจรู้สึกว่าความเป็นอิสระและความเป็นส่วนตัวของพวกเขาถูกละเมิด

จนทำให้เกิดความไม่พอใจและความไว้วางใจลดลง

แม้ประโยชน์ที่ได้รับจากเทคโนโลยีการวิเคราะห์พฤติกรรมที่ขับเคลื่อนด้วย AI

นั้นจะมีมากมาย แต่บริษัทต้องรักษาสมดุลระหว่างการนำ AI มาใช้เพิ่มประสิทธิภาพร่วมกับการดูแลเอาใจใส่ความเป็นอยู่ที่ดีของพนักงานอย่างจริงใจ

เพื่อเลี่ยงผลเสียด้านขวัญกำลังใจและความจงรักภักดีต่อองค์กรในระยะยาว"

ในปี 2570 สัญญาจ้างงานใหม่ 70%

จะรวมข้อกำหนดเรื่องการอนุญาตสิทธิ์และการใช้งานที่เหมาะสมสำหรับการแสดงตัวตนในระบบ

AI

โมเดลภาษาขนาดใหญ่ (LLMs)

ที่เกิดขึ้นไม่มีกำหนดถึงวันสิ้นสุด

นั่นหมายความว่าข้อมูลส่วนบุคคลของพนักงานที่ถูกจัดเก็บโดย LLMs ขององค์กรนั้นจะยังอยู่ใน LLM ทั้งช่วงระหว่างการจ้างงานและหลังจากสิ้นสุดการจ้างงาน

นำไปสู่การถกเถียงในเชิงสาธารณะ

ที่ตั้งคำถามกันว่าพนักงานหรือนายจ้างมีสิทธิ์ในการเป็นเจ้าของตัวตนดิจิทัลนี้หรือไม่

ซึ่งในท้ายที่สุดอาจนำไปสู่การฟ้องร้องทางกฎหมาย

โดยข้อกำหนดการใช้งานอย่างเป็นธรรมจะถูกนำมาใช้เพื่อปกป้ององค์กรจากการฟ้องร้องในทันที

แต่ก็ยังคงก่อให้เกิดข้อขัดแย้งตามมา

ในปี 2570 ผู้ให้บริการด้านสุขภาพ 70%

จะรวมข้อกำหนดและเงื่อนไขที่เกี่ยวข้องกับ AI ด้านอารมณ์ไว้ในสัญญาทางเทคโนโลยี

มิฉะนั้นอาจเสี่ยงต่อความเสียหายทางการเงินหลายพันล้าน

ภาระงานของบุคลากรทางการแพทย์ที่เพิ่มขึ้นจนส่งผลให้มีผู้ลาออก

อีกทั้งความต้องการของผู้ป่วยที่เพิ่มขึ้น และอัตราการหมดไฟ (Burnout)

ของแพทย์ผู้เชี่ยวชาญกำลังก่อให้เกิดวิกฤตความเห็นอกเห็นใจ หรือ Empathy

Crisis โดยการใช้ Emotional AI ในงานต่าง ๆ

อาทิ การเก็บข้อมูลผู้ป่วย สามารถช่วยบุคลากรทางการแพทย์ให้มีเวลาว่างมากขึ้น

ช่วยบรรเทาความเหนื่อยล้าและความคับข้องใจที่ประสบจากภาระงานที่เพิ่มขึ้น

ในปี 2571 บริษัทในดัชนี S&P

30% จะใช้การติดฉลาก Gen AI เช่น "xxGPT"

เพื่อปรับภาพแบรนด์และเพิ่มโอกาสในการสร้างรายได้ใหม่ ๆ

ผู้บริหาร CMO

ต่างมองว่า Gen AI เป็นเครื่องมือที่สามารถใช้เปิดตัวร่วมกับทั้งผลิตภัณฑ์ใหม่และโมเดลธุรกิจใหม่

โดย Gen AI ยังเปิดโอกาสให้เกิดช่องทางรายได้ใหม่ ๆ

จากการนำผลิตภัณฑ์ออกสู่ตลาดได้รวดเร็วขึ้น พร้อมทั้งมอบประสบการณ์ลูกค้าที่ดีขึ้น

รวมถึงทำให้กระบวนการต่าง ๆ เป็นอัตโนมัติ ขณะที่ภูมิทัศน์ของ Gen AI มีการแข่งขันมากขึ้น

หลายบริษัทกำลังสร้างความแตกต่างให้กับแบรนด์ด้วยการพัฒนาโมเดลเฉพาะทางที่ปรับให้เหมาะกับอุตสาหกรรมของตน

ในปี 2571 ราว

25% ของการละเมิดความปลอดภัยในองค์กร จะถูกสืบย้อนกลับไปที่การใช้ AI

agent ในทางที่ผิด ทั้งจากผู้โจมตีภายนอกและภายในที่เป็นอันตราย

องค์กรจำเป็นต้องมีโซลูชันด้านความปลอดภัยและความเสี่ยงใหม่

ๆ เนื่องจาก AI agents เพิ่มพื้นที่การโจมตีที่มองไม่เห็นในองค์กรมากขึ้นอย่างมีนัยสำคัญ

ซึ่งจะบังคับให้องค์กรต้องปกป้องธุรกิจของตนจากผู้โจมตีภายนอกที่ชาญฉลาดและจากพนักงานที่ไม่พอใจที่สร้าง

AI agents เพื่อดำเนินกิจกรรมที่เป็นอันตราย

"องค์กรไม่สามารถรอที่จะนำระบบการควบคุมต่าง

ๆ เพื่อลดภัยคุกคามจาก AI agent มาใช้ได้

ดังนั้นแนวทางที่ง่ายกว่าคือการสร้างระบบการลดความเสี่ยงและความปลอดภัยเข้าไปไว้ในตัวผลิตภัณฑ์และซอฟต์แวร์

ซึ่งดีกว่าเพิ่มเข้าไปหลังจากเกิดเหตุการละเมิดความปลอดภัย"

พลัมเมอร์กล่าวว่า

ในปี 2571 ผู้บริหาร CIOs

40% จะเรียกร้องให้มี "Guardian Agents" สำหรับเฝ้าติดตาม ดูแล หรือควบคุมผลลัพธ์ที่เกิดจากการกระทำของ AI

agent โดยอัตโนมัติ

องค์กรกำลังให้ความสนใจ AI

agents เพิ่มขึ้น แต่เมื่อมีการเพิ่มระดับความอัจฉริยะใน GenAI

agent ใหม่ ๆ

ก็มีแนวโน้มที่ผู้นำด้านผลิตภัณฑ์จะนำมาปรับใช้สำหรับวางแผนเชิงกลยุทธ์อย่างรวดเร็ว

โดย "Guardian Agents" คือการพัฒนาต่อยอดจากแนวคิดการตรวจสอบความปลอดภัย

การสังเกตการณ์ การรับรองการปฏิบัติตามกฎระเบียบ จริยธรรม การกรองข้อมูล

การตรวจสอบบันทึก และกลไกอื่น ๆ อีกมากมายของ AI Agent ซึ่งตลอดปี

2568 ตัวเลขการเปิดตัวผลิตภัณฑ์ที่มี AI agent แบบมัลติเพิลจะเพิ่มขึ้นอย่างต่อเนื่อง

พร้อมกับมียูสเคสการใช้งานที่ซับซ้อนยิ่งขึ้น

"อีกไม่นานการโจมตีด้านความปลอดภัยของ

AI

agent จะเป็นพื้นที่ภัยคุกคามใหม่ ซึ่งการนำมาตรการป้องกัน, ตัวกรองความปลอดภัย, การกำกับดูแลโดยมนุษย์

หรือแม้แต่การสังเกตการณ์ด้านความปลอดภัยมาใช้อาจยังไม่เพียงพอที่จะรับประกันว่าการใช้

AI agent นั้นมีความเหมาะสมและใช้งานได้อย่างสม่ำเสมอ"

พลัมเมอร์ กล่าว

ปี 2570 บริษัทในกลุ่ม Fortune

500 จะเปลี่ยนงบประมาณ 5

แสนล้านดอลลาร์จากค่าใช้จ่ายในการดำเนินงานด้านพลังงานไปสู่ไมโครกริด

เพื่อลดความเสี่ยงเรื้อรังด้านพลังงานและความต้องการด้าน AI

ไมโครกริดคือโครงข่ายพลังงานที่เชื่อมต่อกับการผลิต

การกักเก็บรักษา และการจ่ายพลังงานในระบบที่แยกตัวเป็นอิสระ

ซึ่งสามารถทำงานได้ด้วยตัวเองหรือทำงานร่วมกับระบบโครงข่ายพลังงานหลักเพื่อตอบสนองความต้องการใช้พลังงานในพื้นที่หรือสถานที่ที่มีความเฉพาะ

เทคโนโลยีนี้สร้างความได้เปรียบในการแข่งขันสำหรับการดำเนินงานต่าง

ๆ ในประจำวันและช่วยลดความเสี่ยงด้านพลังงานในอนาคต โดยบริษัทในกลุ่ม Fortune

500

ที่ใช้จ่ายค่าดำเนินงานส่วนหนึ่งไปกับพลังงานควรพิจารณาลงทุนในไมโครกริด

ซึ่งจะให้ผลตอบแทนที่ดีกว่าการจ่ายค่าสาธารณูปโภคที่มีแนวโน้มเพิ่มขึ้นต่อเนื่อง

ที่มา : ฐานเศรษฐกิจ

วันที่ 14 ม.ค. 2568