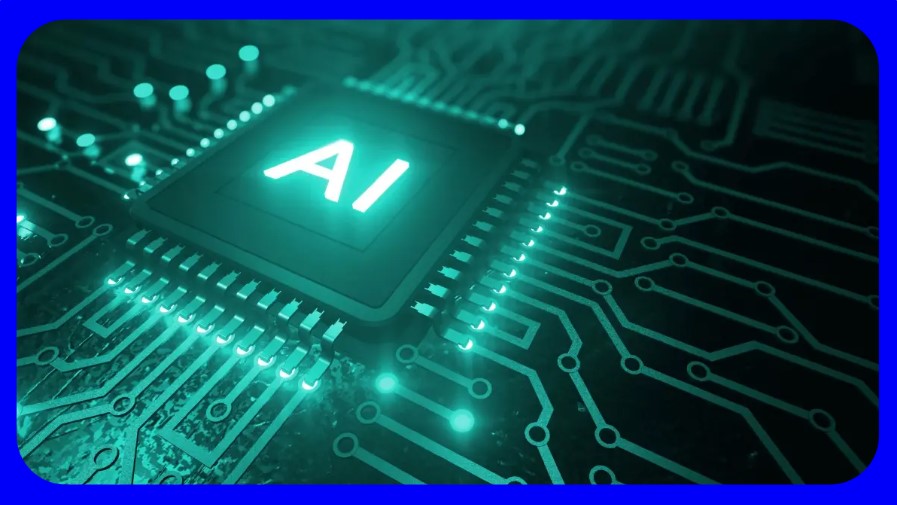

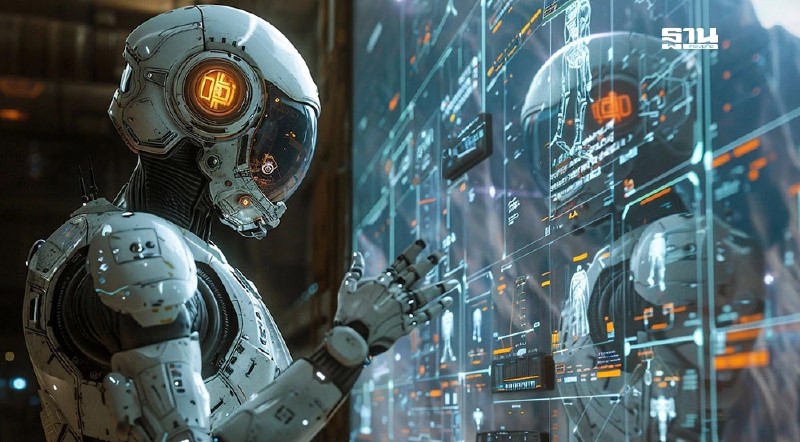

'Agent Economy' จุดเปลี่ยนองค์กร เมื่อ AI กลายเป็น 'แรงงานดิจิทัล'

องค์กรทั่วโลกกำลังเผชิญโจทย์ใหม่ เมื่อ AI

ไม่ได้ทำหน้าที่เพียง “ผู้ช่วย” แต่เริ่มกลายเป็น “แรงงานดิจิทัล”

ที่สามารถลงมือทำงานแทนมนุษย์ได้เอง

การเปลี่ยนผ่านดังกล่าวกำลังถูกเรียกว่า

“Agent

Economy” ซึ่งไม่เพียงเปลี่ยนรูปแบบการทำงาน

แต่ยังเปลี่ยนวิธีคิดเรื่องตัวตนดิจิทัล ความปลอดภัย และการกำกับดูแลระบบองค์กร

เจซี่ ฟอน รองประธานภูมิภาคเอเชีย Ping

Identity เปิดมุมมองว่า ปัจจุบันองค์กรจำนวนมากเริ่มนำ AI

agents มาใช้ในงานจริงแล้ว ตั้งแต่บริการลูกค้าอัตโนมัติ

การจัดการระบบไอที การประมวลผลธุรกรรมทางการเงิน

ไปจนถึงการตัดสินใจแบบเรียลไทม์ในกระบวนการทำงาน

สิ่งที่เกิดขึ้นไม่ใช่เพียงการเพิ่มเครื่องมือ

AI

เข้าไปในระบบเดิม แต่เป็นการเปลี่ยนรูปแบบการดำเนินงานขององค์กร

เพราะซอฟต์แวร์อัจฉริยะเริ่มทำหน้าที่เสมือน “แรงงานดิจิทัล”

ที่สามารถตัดสินใจและดำเนินการได้ด้วยตัวเองมากขึ้น

· ทั่วเอเชียเร่งใช้

AI

Agents

ฟอน ระบุว่า

เอเชียเป็นหนึ่งในภูมิภาคที่การเปลี่ยนผ่านเกิดขึ้นเร็วที่สุด

โดยเฉพาะประเทศที่มีความพร้อมด้านดิจิทัลสูง รวมถึงประเทศไทย

เมื่อ AI ถูกใช้งานในระดับกระบวนการจริง จำนวน “ผู้ใช้งานที่ไม่ใช่มนุษย์”

จะเพิ่มขึ้นอย่างรวดเร็ว ไม่ว่าจะเป็น AI agents, bots, APIs หรือระบบอัตโนมัติรูปแบบต่าง ๆ

อย่างไรก็ดี

องค์กรจำนวนมากยังมองระบบจัดการตัวตนเป็นเรื่องของพนักงานหรืออุปกรณ์ แต่ในอนาคต AI

agents จะกลายเป็นอีกหนึ่งประเภทของตัวตนที่ต้องได้รับการกำกับดูแล

ประเด็นสำคัญคือ AI

agents ไม่ได้เพียงเข้าถึงข้อมูล แต่ยังสามารถดำเนินการแทนมนุษย์ได้

หากขาดกลไกควบคุมที่เหมาะสม ความเสี่ยงจะขยายตัวเร็วกว่าการใช้ซอฟต์แวร์แบบเดิม

· เมื่อ

‘ตัวตน’ ไม่ได้มีแค่มนุษย์

หนึ่งในแนวคิดหลักที่ Ping

Identity ผลักดัน คือ “Identity for AI” หรือการใช้ระบบจัดการตัวตนเป็นโครงสร้างพื้นฐานหลักสำหรับควบคุม

AI

ฟอน อธิบายว่า ระบบ IAM

(Identity and Access Management) แบบดั้งเดิม

ถูกออกแบบมาสำหรับผู้ใช้งานที่เป็นมนุษย์หรือแอปพลิเคชันแบบคงที่ แต่ AI

agents มีลักษณะแตกต่าง เพราะสามารถเรียนรู้ ตัดสินใจ

และโต้ตอบกับหลายระบบแบบเรียลไทม์

ด้วยเหตุนี้ องค์กรจึงต้องปฏิบัติต่อ AI

agents เสมือนเป็น “ตัวตนหลัก” นั่นหมายความว่า AI agent ทุกตัวควรมีตัวตนเฉพาะ มีเจ้าของที่ชัดเจน มีบทบาทหน้าที่ที่กำหนดไว้

และมีวงจรชีวิตที่ตรวจสอบได้ตั้งแต่เริ่มใช้งานจนสิ้นสุด

นอกจากนี้

รูปแบบการให้สิทธิ์เข้าถึงระบบจำเป็นต้องเปลี่ยนจาก “Static

Access” ไปสู่การประเมินสิทธิ์แบบต่อเนื่องตามบริบท พฤติกรรม

และความเสี่ยง

การให้สิทธิ์เพียงครั้งเดียวแล้วปล่อยให้ระบบทำงานต่อเนื่อง

อาจไม่เพียงพอสำหรับ AI agents เพราะพฤติกรรมของระบบสามารถเปลี่ยนแปลงได้ตลอดเวลา

แนวทางดังกล่าวสอดคล้องกับแนวคิด Zero

Trust ที่กำลังกลายเป็นมาตรฐานด้านความปลอดภัยไซเบอร์ขององค์กรทั่วโลก

· ระบบตัวตนในฐานะ

‘Trust

Layer’

Ping

Identity มองว่า ระบบจัดการตัวตนจะกลายเป็น “Trust Layer” หรือชั้นความเชื่อถือสำหรับ AI โดยทุกการกระทำของ AI

agents ต้องสามารถยืนยันตัวตน กำหนดสิทธิ์ และตรวจสอบย้อนหลังได้

จุดเริ่มต้นคือการทำให้ AI

agent ทุกตัวมีตัวตนที่ตรวจสอบได้ก่อนเข้าถึงระบบหรือข้อมูล

จากนั้นองค์กรต้องใช้การกำหนดสิทธิ์แบบละเอียด (Fine-Grained

Authorisation) เพื่อประเมินทุกการกระทำแบบเรียลไทม์ตามบริบทและความเสี่ยง

อีกส่วนสำคัญคือ

“ความสามารถในการตรวจสอบย้อนหลัง” ทุกการกระทำของ AI agents ควรถูกบันทึกและเชื่อมโยงกลับไปยังผู้รับผิดชอบที่ชัดเจน

เพื่อให้สามารถตรวจสอบเหตุการณ์หรือพิสูจน์ความถูกต้องของการตัดสินใจได้

ฟอน มองว่า ในอนาคต

ระบบตัวตนจะไม่ใช่เพียงด่านหน้าของระบบอีกต่อไป

แต่จะกลายเป็นโครงสร้างควบคุมหลักของทุกปฏิสัมพันธ์ที่ขับเคลื่อนด้วย AI

· ความเสี่ยงใหม่

‘Shadow

AI Agents’

อีกหนึ่งประเด็นที่เริ่มถูกจับตา คือ “Shadow

AI Agents” หรือ AI agents ที่ถูกนำมาใช้งานนอกการกำกับดูแลของฝ่ายไอทีและฝ่ายความปลอดภัย

หลายองค์กรกำลังเผชิญปัญหาคล้าย “Shadow

IT” ในอดีต แต่ซับซ้อนกว่า เพราะ AI agents สามารถเข้าถึงข้อมูลและดำเนินการอัตโนมัติได้ด้วยตนเอง

ปัญหาสำคัญคือองค์กรอาจไม่รู้ด้วยซ้ำว่ามี

AI

agents ตัวใดกำลังทำงานอยู่ในระบบ และกำลังเข้าถึงอะไรอยู่บ้าง

เธอแนะนำว่า องค์กรควรเริ่มสร้าง “Unified

Identity Framework” หรือกรอบการจัดการตัวตนแบบรวมศูนย์ เพื่อดึง AI

agents ทั้งหมดเข้ามาอยู่ภายใต้การกำกับดูแลเดียวกัน

· ‘ธรรมาภิบาล’

ยังเป็นช่องว่าง

ฟอน มองว่า

ประเทศไทยเป็นหนึ่งในตลาดที่มีความกระตือรือร้นด้าน AI

สูงในภูมิภาค โดยเฉพาะในภาคธนาคาร ดิจิทัลคอมเมิร์ซ

และบริการออนไลน์

แต่ระดับความพร้อมด้านระบบจัดการตัวตนและความปลอดภัยยังตามไม่ทันความเร็วในการใช้งาน

AI

หลายองค์กรให้ความสำคัญกับการสร้างประสิทธิภาพและนวัตกรรมจาก

AI

ก่อน ขณะที่การกำกับดูแลและความปลอดภัยมักถูกพิจารณาทีหลัง

เมื่อ AI agents เข้ามาเป็นส่วนหนึ่งของกระบวนการทางธุรกิจมากขึ้น

พื้นผิวการโจมตีและความซับซ้อนในการบริหารสิทธิ์ก็เพิ่มขึ้นตามไปด้วย

อีกหนึ่งความท้าทายสำคัญ

คือเรื่องความโปร่งใส ความสามารถในการอธิบายการตัดสินใจของ AI

(Explainability) และการปฏิบัติตามข้อกำหนดด้านกฎระเบียบที่กำลังเข้มข้นขึ้น

ในมุมของ Ping Identity ระบบตัวตนจะกลายเป็นกลไกสำคัญในการสร้างความโปร่งใส เพราะหากทุก AI

agent ถูกปฏิบัติเป็นตัวตน และทุกการกระทำถูกยืนยันตัวตน

กำหนดสิทธิ์ และติดตามตรวจสอบได้

องค์กรจะสามารถสร้างลำดับความรับผิดชอบที่ชัดเจนสำหรับทุกการตัดสินใจของ AI

ขณะที่ความสามารถในการสร้าง “Trust”

จะกลายเป็นปัจจัยสำคัญของการแข่งขันในยุค Agent Economy เพราะเมื่อ AI เริ่มมีบทบาทในกระบวนการตัดสินใจมากขึ้น

ความน่าเชื่อถือของระบบจะกลายเป็นสิ่งที่ทั้งลูกค้า หน่วยงานกำกับดูแล

และองค์กรพันธมิตรให้ความสำคัญ

อนาคตของ AI ไม่ได้ขึ้นอยู่กับว่าองค์กรใช้ AI ได้เร็วแค่ไหนเพียงอย่างเดียว

แต่ขึ้นอยู่กับว่าองค์กรสามารถควบคุม AI ได้ดีเพียงใด

ที่มา : กรุงเทพธุรกิจ

วันที่ 12 พ.ค. 2569