กฎหมายควบคุมการใช้ AI ประเทศใดเริ่มบังคับใช้บ้างแล้ว | กฎหมาย 4.0

ทั้งเพื่อช่วยในการอำนวยความสะดวก

เช่น ระบบสแกนใบหน้า ระบบสั่งการด้วยเสียง ไปจนถึงการคิดวิเคราะห์ที่ซับซ้อน เช่น

การวิเคราะห์ข้อมูลเพื่อการวางแผนทางธุรกิจ

อย่างไรก็ดี

เทคโนโลยีใดๆ มักมาพร้อมกับปัญหาโดยเฉพาะในเชิงจริยธรรมและความรับผิดทางกฎหมาย

หลายประเทศจึงเร่งร่างและตรากฎหมายที่เกี่ยวข้องกับการพัฒนาและการใช้

AI

อย่างปลอดภัยและเป็นธรรม เพื่อใช้ในการกำกับควบคุมทั้งผู้พัฒนาระบบ

ผู้ใช้งาน และระบบ AI เอง

โดยพยายามที่จะสร้างสมดุลระหว่างนวัตกรรมกับความมั่นคงทางสังคม

สหภาพยุโรปได้ออก

Artificial

Intelligence Act (AI Act) เพื่อควบคุมการใช้ AI ที่มีความเสี่ยงสูง

และป้องกันการนำไปใช้ในทางที่ขัดต่อค่านิยมของสหภาพยุโรป

หรือละเมิดต่อสิทธิมนุษยชนโดยเริ่มมีผลใช้บังคับในปี 2568 กฎหมายฉบับนี้แบ่งประเภท

AI ตามระดับความเสี่ยงและกำหนดข้อบังคับที่เหมาะสมสำหรับแต่ละระดับความเสี่ยง

ดังนี้

(1)

AI

ที่มีความเสี่ยงที่ยอมรับไม่ได้ (Unacceptable risk) - ระบบ AI ที่อาจเป็นภัยคุกคามต่อความปลอดภัย

การดำรงชีวิต และสิทธิของประชาชนอย่างชัดเจน จึงห้ามไม่ให้ดำเนินการ เช่น การใช้ AI

ในการเก็บข้อมูลและวิเคราะห์พฤติกรรมเพื่อกำหนดคะแนนของประชาชนและนำไปใช้เพื่อกำหนดการได้รับสิทธิพิเศษหรือถูกจำกัดสิทธิบางประการ

(2)

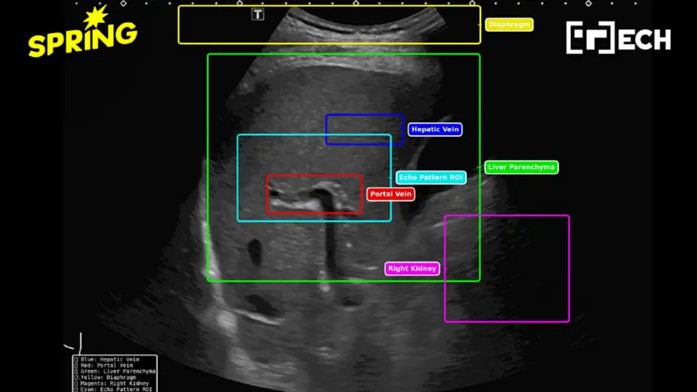

AI

ที่มีความเสี่ยงสูง (High risk) - ระบบ AI ที่อาจส่งผลต่อหรือก่อให้เกิดความเสี่ยงร้ายแรงต่อสุขภาพ

ความปลอดภัย หรือสิทธิขั้นพื้นฐานของประชาชน จึงต้องขออนุญาตก่อนดำเนินการ เช่น

การใช้ AI ในทางการแพทย์เพื่อวินิจฉัยโรค

หรือใช้ในการคัดเลือกผู้สมัครงาน

(3)

AI

ที่มีความเสี่ยงจำกัด (Limited risk) - การใช้

AI ประเภทนี้

กฎหมายกำหนดให้ต้องแจ้งผู้ใช้บริการว่ากำลังมีการใช้งาน AI เพื่อไม่ให้เกิดความเข้าใจผิดและให้เกิดความโปร่งใสในการใช้งาน

เช่น AI chatbot

(4)

AI

ที่มีความเสี่ยงน้อย (Minimal risk) - AI ที่เป็นส่วนหนึ่งในชีวิตประจำวันและไม่ก่อให้เกิดผลกระทบต่อความปลอดภัยหรือสิทธิของบุคคล

จึงไม่ได้มีการกำหนดหลักเกณฑ์ใดให้ดำเนินการ เช่น กรณี AI ที่ใช้เล่นเกม

หรือกรองสแปมเมล

สำหรับในสหรัฐอเมริกา

แม้ยังไม่มีกฎหมายกลางที่บัญญัติในเรื่อง AI แต่หลายมลรัฐเริ่มบังคับใช้กฎหมายที่เกี่ยวข้องกับ

AI แล้ว เช่น

อาร์คันซอว์

ได้ออก Arkansas

Act 927

ซึ่งกำหนดเรื่องสิทธิความเป็นเจ้าของในเนื้อหาและการฝึกอบรมแบบจำลอง (model

training) ที่สร้างขึ้นโดยใช้ AI โดยกฎหมายกำหนดให้ผู้ป้อนคำสั่งเป็นผู้มีสิทธิเป็นเจ้าของเนื้อหาเหล่านั้น

บนเงื่อนไขว่างานที่สร้างขึ้นนั้นต้องไม่ละเมิดทรัพย์สินทางปัญญาของผู้อื่น

ในทำนองเดียวกัน

ผู้ที่ให้ข้อมูลเพื่อฝึกอบรมแบบจำลองปัญญาประดิษฐ์เชิงสร้างสรรค์ (generative

AI) ก็จะเป็นเจ้าของผลลัพธ์แบบจำลองที่ได้ฝึกมา

หากข้อมูลที่ใช้ได้มาโดยชอบด้วยกฎหมาย

และไม่มีการโอนสิทธิความเป็นเจ้าของผ่านสัญญาล่วงหน้า

ทั้งนี้ยกเว้นในกรณีสัญญาจ้างทำของ ซึ่งแม้ผู้รับจ้างจะใช้ AI ในการสร้างงานขึ้นมา ผู้ว่าจ้างจะเป็นเจ้าของงานเหล่านั้น

โคโลราโด

ได้ออก Colorado

AI Act ซึ่งนับได้ว่าเป็นกฎหมาย AI ฉบับสมบูรณ์ฉบับแรกของสหรัฐฯ

และจะมีผลบังคับใช้ในปี 2026

กฎหมายฉบับนี้กำหนดหน้าที่ทั้งต่อนักพัฒนาและผู้ใช้งานระบบ AI โดยเน้นไปที่ระบบ AI ที่ใช้ในการตัดสินใจแบบอัตโนมัติ

และนิยามระบบ AI ที่มีความเสี่ยงสูงว่าคือระบบที่เมื่อนำมาใช้งานแล้ว

จะตัดสินใจเองหรือมีส่วนสำคัญในการตัดสินใจที่ส่งผลกระทบอย่างมีนัยสำคัญทางกฎหมายหรือเทียบเท่า

เช่น

ส่งผลต่อการเข้าถึงหรือเงื่อนไขของบริการต่าง ๆ ไม่ว่าจะเป็น การศึกษา การจ้างงาน

การรักษาพยาบาล ฯลฯ

นอกจากนี้กฎหมายฉบับนี้ให้ความสำคัญในเรื่องอคติและการเลือกปฏิบัติ

โดยกำหนดให้ผู้พัฒนาและผู้ใช้งานระบบ AI ต้องใช้ความระมัดระวังอย่างสมเหตุสมผลในการหลีกเลี่ยงการเลือกปฏิบัติในการตัดสินใจที่มีผลกระทบในด้านต่าง

ๆ ที่กล่าวถึงข้างต้น

ญี่ปุ่น

ได้ออกกฎหมายว่าด้วยการส่งเสริมการวิจัย พัฒนาและการใช้เทคโนโลยีที่เกี่ยวข้องกับ AI

ซึ่งมีเป้าหมายเพื่อส่งเสริมและผลักดันนโยบายด้าน AI อย่างครอบคลุมและเป็นระบบ

โดยมีวัตถุประสงค์เพื่อยกระดับคุณภาพชีวิตของประชาชนและส่งเสริมการพัฒนาเศรษฐกิจของประเทศอย่างมั่นคง

และได้กำหนดหลักการพื้นฐานที่สำคัญคือ

การดำเนินการอย่างเหมาะสมเพื่อป้องกันผลกระทบในทางลบ เช่น

การนำไปใช้ในทางอาชญากรรม การรั่วไหลของข้อมูลส่วนบุคคล และการละเมิดลิขสิทธิ์

นอกจากนี้ยังกำหนดให้จัดทำแผนพื้นฐานด้าน

AI

และจัดตั้งศูนย์ยุทธศาสตร์ AI ภายใต้การนำของนายกรัฐมนตรี

เพื่อประสานนโยบายระดับชาติด้าน AI อย่างเป็นเอกภาพ

ประเทศไทย

อยู่ระหว่างการปรับปรุงร่างหลักการของกฎหมายว่าด้วยปัญญาประดิษฐ์

ซึ่งภายใต้ร่างหลักการของกฎหมายใหม่นี้ มีการกำหนดให้ใช้ Sandbox

เพื่อเป็นกลไกในการช่วยทดสอบ AI ภายใต้สภาพแวดล้อมที่มีการควบคุมอย่างใกล้ชิด

โดยมีหน่วยงานกำกับดูแล

เข้ามาร่วมดูแล ให้คำแนะนำ และช่วยประเมินความเสี่ยงที่อาจเกิดขึ้น

เพื่อลดความเสี่ยงก่อนนำไปใช้จริง

โดยเฉพาะในกรณีที่เกี่ยวข้องกับข้อมูลส่วนบุคคลหรือกลุ่มเปราะบาง

ถือเป็นแนวทางสร้างสมดุลระหว่างการส่งเสริมนวัตกรรมอย่างยั่งยืนและการคุ้มครองสิทธิประชาชน

นอกจากนี้

ประเทศไทยยังมีกฎหมายที่อาจควบคุมการใช้ AI ได้บางส่วน

เช่น พ.ร.บ.คุ้มครองข้อมูลส่วนบุคคล พ.ศ. 2562 (PDPA) ในเรื่องการใช้

AI ประมวลผลข้อมูลส่วนบุคคล และพ.ร.บ.

ว่าด้วยการกระทำความผิดเกี่ยวกับคอมพิวเตอร์ พ.ศ. 2560 ที่อาจใช้ควบคุมการใช้งาน deepfake

อย่างไรก็ตาม

กฎหมายเหล่านี้ไม่ได้ถูกออกแบบมาเพื่อรองรับความซับซ้อนของ AI

ในปัจจุบัน โดยเฉพาะเรื่องความรับผิดทางแพ่งและอาญาหาก AI ทำให้เกิดความเสียหาย เช่น รถยนต์ไร้คนขับชนคน

ดังนั้น

จึงหวังว่าไทยจะเร่งออกกฎหมายเพื่อควบคุมการใช้ AI และในระหว่างนี้ ควรเร่งปลูกฝังแนวคิดการใช้ AI อย่างมีจริยธรรมควบคู่ไปด้วย

ทั้งควรพิจารณาจัดตั้งคณะกรรมการกำกับดูแล AI แห่งชาติ

ที่มีผู้เชี่ยวชาญจากศาสตร์ต่าง ๆ ที่เกี่ยวข้อง

เช่น

คอมพิวเตอร์ วิศวกรรม คณิตศาสตร์ เศรษฐศาสตร์ กฎหมาย สิทธิมนุษยชน และจริยธรรม

เพื่อช่วยกันวางกฎเกณฑ์โดยคำนึงถึงปัจจัยต่างๆ ได้ครบถ้วนและสามารถใช้ได้จริง.

ที่มา

:

กรุงเทพธุรกิจ

วันที่

8 กันยายน 2568